OpenAI ingin GPT-4 menggantikan semua moderator Internet. Pertanyaannya adalah apakah itu tidak akan membuatnya lebih buruk

Perkembangan kecerdasan buatan terus berlanjut. Perusahaan teknologi terus melatih model bahasa mereka, perusahaan perangkat keras seperti Nvidia terus mengembangkan alat yang semakin kuat dan Sam Altman, CEO OpenAI, sangat yakin bahwa AI akan mematikan pekerjaan. Salah satunya tentang moderator, karena sekarang perusahaan menginginkan GPT-4 untuk memoderasi Internet.

Moderasi yang dibantu AI. OpenAI adalah perusahaan yang mengembangkan model bahasa GPT. Selain dapat digunakan di platform Anda sendiri, kami memiliki GPT-4 di aplikasi pihak ketiga, seperti mesin pencari Bing milik Microsoft. Ini adalah model bahasa yang paling populer, dan setelah hampir identik dengan “kecerdasan buatan”, OpenAI ingin GPT-4 memoderasi konten Internet. Sebagai? Platform akan menangani sebagian besar dan menerapkan koreksi yang konsisten sementara sekelompok manusia mengawasi.

Avez-vous vu celaKUTIPAN-Reaksi terhadap kepala tentara bayaran Wagner Yevgeny Prigozhin dalam kecelakaan pesawat tanpa ada yang selamat

Sebelumnya, perlu memoderasi dia. Sebelum melihat proposal OpenAI, sekarang saatnya bertanya pada diri sendiri apakah GPT sendiri sudah siap untuk ini. Beberapa minggu yang lalu mereka menonaktifkan alat pemeriksa teks yang memungkinkan, berkat analisis AI, untuk menemukan artikel yang ditulis dengan alat ini. Singkatnya, itu meleset lebih dari senapan tontonan karena akurasi hanya 26%. Perusahaan menyatakan bahwa mereka akan terus menyelidiki untuk membuat sistem yang lebih baik, tetapi kami masih belum memiliki solusi.

Ada kasus dan kasus. Kembali ke tujuan memoderasi internet, ketika kita berbicara tentang memoderasi, kita mungkin berpikir bahwa mereka akan bertugas mengatur postingan di foto atau jejaring sosial, tetapi tidak hanya itu. Moderasi berkisar dari komentar di mana seseorang menghina konten yang beracun atau yang secara langsung melanggar hak asasi manusia.

Ada platform seperti Facebook yang memiliki sistem dukungan moderasi yang sangat spesifik berdasarkan model kecerdasan buatan, tetapi yang diinginkan OpenAI adalah agar ada kriteria umum untuk sebagian besar konten yang ditemukan di Internet.

Siapa yang memoderasi moderator. Tapi tentu saja, setidaknya untuk saat ini, kecerdasan buatan didasarkan pada moralitas (bisa dibilang) orang yang melatihnya dan OpenAI menyatakan bahwa model bahasa dapat membuat penilaian moderasi berdasarkan pedoman yang diberikan kepada mereka. Mereka dapat memahami dan menghasilkan bahasa alami yang cocok untuk moderasi, tetapi moralitas manusia masih ada di belakangnya. Itu membuat kami bertanya-tanya aturan apa yang akan diikuti atau apakah akan ada dewan dengan kriteria berbeda yang melatih kecerdasan buatan.

Beberapa sudah menggunakan GPT-4 untuk moderasi, dan faktanya, sebuah distrik sekolah di Iowa menanyakan kepada ChatGPT buku mana yang berisi deskripsi atau penggambaran tindakan seksual untuk kemudian dihapus dari perpustakaan. Siapa yang menandai moral ChatGPT di sini? Pengawas Mason City Bridgette Exman, dan dari 19 buku yang dihapus, hanya empat yang memiliki konten eksplisit atau seksual. Salah satunya adalah ‘The Handmaid’s Tale’.

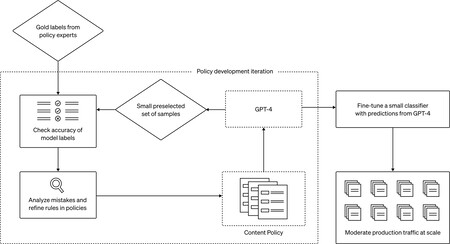

dari bulan ke jam. Tapi hei, begitu AI memiliki beberapa pedoman, OpenAI mengklaim dapat merampingkan proses moderasi dari bulan ke jam. Secara khusus, ini adalah langkah-langkah yang mereka usulkan:

- Setelah pedoman disusun, para ahli dapat membuat kumpulan data dengan sampel kecil yang mereka berikan label yang sesuai dengan pedoman yang diusulkan pada awalnya. Dengan ini, mereka menguraikan beberapa jawaban.

- GPT-4 mengasimilasi pedoman dan, tanpa melihat jawaban dari para ahli, melakukan proses pemberian label pada sampel data.

- Para ahli menganalisis perbedaan antara penilaian mereka dan GPT-4 dan, menganalisis kemungkinan ambiguitas, membuat perubahan sehingga GPT-4 memiliki pedoman dan kriteria yang lebih jelas untuk diterapkan.

Proses moderasi GPT-4.

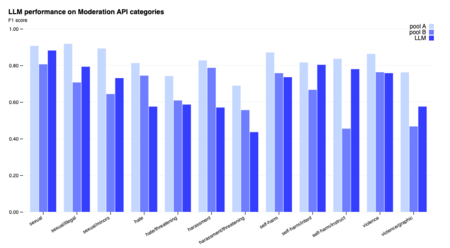

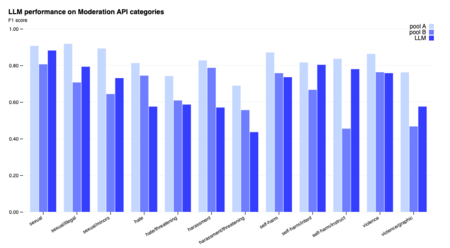

Ini adalah hasil dalam tes mereka. LLM adalah GPT-4 dan mereka mengklaim hasilnya mirip dengan manusia dengan pelatihan ringan (sampel B). Moderator berpengalaman (sampel A) masih unggul.

Dengan ini dilakukan, OpenAI membagikan bahwa tim pelatihan dapat mengulangi langkah dua dan tiga hingga mereka puas dengan tanggapan dari AI. Dan, pada akhirnya, hal ini akan mempercepat pekerjaan manusia karena dapat menangani sampel berskala besar maupun dengan cara yang lebih konkret.

Lebih sedikit stres pasca trauma. Salah satu tujuan yang ditetapkan oleh OpenAI adalah membuat moderasi konten lebih konsisten, selalu menerapkan kriteria yang sama sekaligus dapat dengan cepat beradaptasi dengan sudut pandang baru. Namun, itu bukan satu-satunya. Mereka juga mengklaim bahwa tujuan lain adalah untuk mengurangi beban mental moderator manusia. Ada banyak berita yang, dari waktu ke waktu, memicu peringatan dengan mengungkapkan bahwa moderator mengembangkan stres pasca-trauma (seperti Microsoft, Facebook, TikTok, atau YouTube).

Faktanya, dalam sebuah wawancara dengan Semafor, Lilian Weng, direktur sistem keamanan di OpenAI, telah mengkonfirmasi bahwa sistem ini dapat membantu dengan disinformasi, tetapi juga dengan konten seperti pornografi anak. Dan itu adalah, mereka sedang menyelidiki bagaimana menerapkan sistem moderasi ini pada gambar dan video.

Peran manusia. Kami tidak tahu apakah ini akan membunuh pekerjaan itu atau tidak, atau apakah Altman mengacu pada mereka ketika dia baru-baru ini mengatakan bahwa AI jelas akan membunuh pekerjaan manusia, tetapi untuk saat ini jelas bahwa akan ada manusia yang mengatur kecepatan kecerdasan buatan. dan memiliki kata terakhir dalam proses moderasi.

Di : OpenAI telah mengumumkan strateginya untuk mencegah risiko dengan superintelligence: superalignment